cuda编程教程

CUDA是NVIDIA针对其GPU开发的并行计算平台和编程模型。其核心目标是提供一种高效利用GPU并行计算能力的编程框架。下面将介绍CUDA编程框架的基本概念以及如何进行CUDA编程。

一、基本概念:

1. 核心概念:

Host:指CPU端,即主机端。

Device:指GPU端。

Kernel:在GPU上执行的函数,由Host发起调用,每个Kernel在GPU上的每个线程都会同时执行该函数。

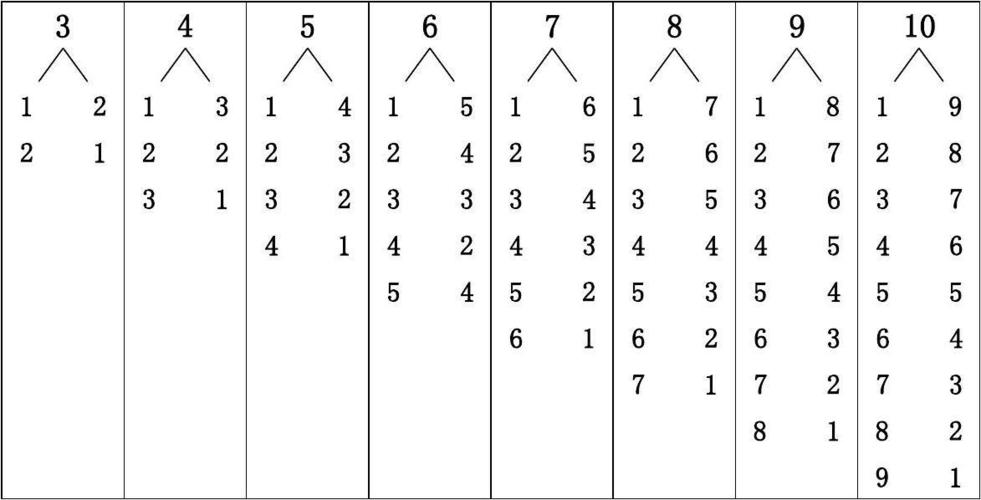

Grid:一组线程块组成的二维或三维数组。

Block:线程块,是线程执行的最小单位,每个Block中可以包含多个线程。

Thread:线程,是执行任务的最小单元。

2. 内存模型:

Host内存:主机端的内存,由CPU管理。

Device内存:GPU端的内存,由GPU管理。要注意Host和Device内存之间的数据传输。

3. 并行计算模型:

SPMD(Single Program, Multiple Data):单程序多数据。每个线程执行相同的程序,但是处理不同的数据。

二、CUDA编程步骤:

1. 分配、传输和释放内存:

使用cudaMalloc函数分配Device上的内存。

使用cudaMemcpy函数将数据从Host内存拷贝到Device内存。

使用cudaMemcpy函数将数据从Device内存拷贝到Host内存。

使用cudaFree函数释放Device上的内存。

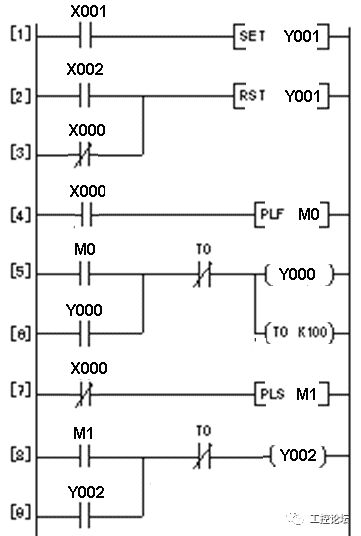

2. 定义并调用Kernel函数:

使用__global__关键字定义Kernel函数。

使用<<

在Kernel函数中,可以使用threadIdx、blockIdx和blockDim等内置变量来访问线程和线程块的索引。

3. 使用GPU并行计算:

在Kernel函数中,将需要并行计算的任务分配给不同的线程。

利用线程的索引和线程块的索引来确定每个线程应该处理的数据。

4. 处理结果:

将计算结果从Device内存拷贝到Host内存。

在Host上进行后续处理,如输出结果或进一步计算。

三、CUDA编程建议:

1. 合理管理内存:

GPU内存有限,需要合理分配和释放内存,避免内存溢出或内存泄露问题。

尽量减少Host和Device内存之间的数据传输,以提高性能。

2. 选择合适的数据结构和算法:

GPU对于特定类型的任务和数据结构具有更好的处理能力,如矩阵计算、向量加速等。

在选择算法时,要考虑GPU的并行计算特性,尽量避免串行操作。

3. 优化并行计算:

合理分配线程和线程块,充分利用GPU的并行计算能力。

使用共享内存等技术提高数据访问效率。

减少线程之间的同步开销,避免浪费GPU计算资源。

通过CUDA编程框架,可以实现针对GPU的高效并行计算。在进行CUDA编程时,需要了解基本的概念和步骤,并根据实际情况做出合理的选择和优化。合理管理内存、选择合适的数据结构和算法,以及优化并行计算,都是提高CUDA编程性能的重要因素。

版权声明

本文仅代表作者观点,不代表百度立场。

本文系作者授权百度百家发表,未经许可,不得转载。